仙农的主要贡献是创立了经典信息论。他在贝尔电话实验室从数学上和技术上研究“通信”、“信息”、“消息”等概念,其顶点则是1948年在《贝尔系统技术杂志》上发表“通信的数学理论”。这篇分两期刊出、长达80余页的文章成了信息论的开端。论文很难读。1949年,由W。韦佛(Weaver)注释后出版了单行本。

信息论在1984年取得成功并不是偶然的。这时,数学上的概率论、数理统计、数理逻辑、运筹学,工程上的通信技术、电子技术、自动控制技术等都在逐渐成熟。计算机出现了,统计力学、量子力学、生物学提供了重要的科学方法。仙农正是站在前人的肩膀上看到了曙光。

仙农首先采用严密的数学方法,对信源、信息、信息量、信道、编码、解码、传输、接收、滤波等一系列基本概念,进行严格的数学描述和定量度量,使得信息研究由粗糙的定性分析阶段进入精密的定量阶段,并因此而发展成一门真正的科学学科。

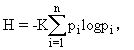

对莫尔斯电报编码的研究将会导致用概率观念考察信息。比如,在英文电报中,“字母E的出现概率比Q大得多,序列TH出现的概率比XP大得多。”由此仙农进一步注意到:“通信的基本问题是在消息的接收端精确地或近似地复现发送端所挑选的消息。通常的消息是有意义的,……而通信的语义方面问题和工程问题是没有关系的。”“重要的是,一个实际信息总是从可能消息的集合中选择出来的。”这就是说,仙农认识到两个要点:(1)通讯工程与语义无关;(2)通信系统所处理的信息本质上是随机的。于是他想到“信息是可用来消除不肯定的东西”,并尝试采用概率方法给信息量下精确定义。设信息源有n个不同的符号。x1,x2…xn,它们出现的概率分别为p1(x1),p2(x2)…pn(xn)。仙农引入信息熵的概念:

其中K是某一常数,它表示信息源的某种不确定程度,成为信息量的一种量度。信息熵借用了19世纪热力学第二定律中热力熵的想法。这里,仙农不把信息看作有意义的消息,而是当作信息源中各元素符号组合成消息时的自由度,即各元素符号相继出现的不肯定程度。显然,自由度越大,信息量也越大。比如,如果a的后面只能出现b,没有自由选择的机会,那么消息a和ab的信息量是一样的。所以,用不肯定度(或自由度,或混乱程度)来刻画信息量,是很自然的事。正是这一革命性的思想,成了经典信息论的基石。信息量的定义中的对数若以2为底,其单位被仙农称为比特,而当取10或e为底时,相应的单位称为迪西特(decit)与奈特(nat)。

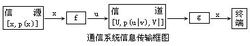

仙农用随机观念考察通信理论,确实是一项重大的突破。20世纪初蓬勃发展的概率论和数理统计为信息论提供了合适的数学工具。他指出:“离散信源是一个一个符号地产生消息的。相继符号的选择是根据某些概率,而通常这些概率取决于前面符号的选择及待选的符号。任何一个能产生由一组概率控制的符号序列的物理系统,或物理系统的数学模型都可称为随机过程。”这样一来,平稳随机过程、统计相关理论等数学成果迅速转移到通信过程的研究领域中来。仙农描述的通信系统是:

信源:由一个消息符号表X和X上的概率分布p(x)表示。

编码:把信源消息变为可向信道输入的信号的运算。数学上指函数fn:Xn→Un。

信道:由输入(拍发)信号集合U,输出(接收)信号集合V,转移概率分布矩阵p(u v)构成。其中p(u v)为拍发u条件下接收为v的概率。

译码:把信道接收信号还原为信源消息的运算,即gn:Vn→Xn。

仙农对信息论的又一贡献,是对信道最大容量的描述和研究。信道容量是指每秒在信道中可通过C个单位。今有每秒输出H个单位的信源,他提出的一个结论是:在没有噪声干扰的情况下,符号传输的平均速率有一个上限C/H,它可以逼近,但不能超越。为了将这一定理推广到具有噪声干扰的实际情形,仙农将两种不肯定性加以区别。一种是由误发和噪声干扰产生的“不需要的”不肯定性,另一种是信源本身所具有的“需要的”不肯定性。于是,有用的信息应为信源的不肯定性减去噪声带来的模糊性。仙农指出:当C>H时,传输误差可以变得很小;而当C小于H时,误差就难以控制了。因此,“不需要的”不肯定性必须大于或等于H-C。最后,至少有一种编码能降低噪声引起的模糊程度,使之非常接近H-C。仙农给出了这一重要定理的严格表述:

信息论基本定理。已知一个具有容量C>0的平稳无记忆通道,以及取自一个遍历信源的任意信号(数据),则对任一ε>0和正数R(0<R<C),必存在充分长的编码信号(a1,a2…an),它以传输速率R传递数据,同时译码错误的概率小于ε。

仙农的信息论研究先处理离散的随机变量,而后很容易地推广到连续的情形,几乎无需作重大修改。

仙农在1948年发表的原始论文,并未期望对通信系统会有广泛的工程技术应用。然而人们很快就意识到仙农所提供的工具对实际通信十分有效。例如,通信中常有一些信息是多余的。我们在打电报时,总是努力压缩字数以减少多余。但是仙农指出,信息的多余往往是有用的,消灭多余倒未必有利。英语中的多余度约为百分之五十。例如,一条消息“To err is human”(人孰无过)经传输后接收为“Too err is fuman”,一般有些知识的人都能读懂,可是如果拍发“Yanks beat reds”而接收成“Yanks beat rebs”,虽然只错一个字母(d变成b),意思却没法猜了。这是因为两条消息的多余度不同。

仙农在1948年发表的原始论文,“犹如一颗重磅炸弹起爆,震撼了科学界”。全新的思想,独创的方法,一时成为人们争相仿效的典范。它不仅在理论上十分精致和漂亮,而且为许多工程技术问题的解决提供了新工具,带来了新的希望,具有很高的实用价值。然而,也有一些情况不大正常。1956年,仙农曾这样说:“近几年来,信息论简直成了最时髦的学科。它本来只是通信工程师所采用的一种技术手段,但现今竟然在普通杂志和科学刊物上都会占有重要地位。……它已名过其实。许多不同学科的同事们,或因慕其名,或希望寻求科学分析的新途径,都把新兴理论引入各自的领域。总之,现在信息论已经名声在外。这种声誉固然使我们本学科的人感到愉快和兴奋,但也孕育着一种危险……信息论决不是通信工作的万灵药方,而对其他人则更是如此。要知道,一次就能打开全部自然奥秘的事情,是十分罕见的。否则,人们一旦知道仅仅用几个像信息、熵、多余度这样一些动人字眼并不能解决全部问题的时候,就会大失所望。那种人为的繁荣就会在一夜之间突然崩溃。”

仙农的忠告在50年代后半期受到重视,使信息论的发展走上更健康的轨道。过去的几十年,现代的信息技术在仙农的基础上迅猛发展,诸如信号的数学化、微波技术、卫星通信都成为巨大的产业。由于电子计算机的长足发展和迅速普及,信息科学正向医学、生物学、遗传工程、语言学、心理学、管理科学、经济学等几乎所有的社会科学和自然科学的各个学科渗透、溶合,甚至渗入到人们的日常生活之中,这种情形,在数学史乃至整个科学史上都是十分罕见的。

仙农在40—50年代达到科学事业的高峰,以后仍继续有科学成果发表,也有一些较重要工作。例如,1959年的论文提出了保真度准则下的离散信源编码定理,以后发展成“信息率失真论”,成为频带压缩和数据压缩的理论基础。1967年还看到他和别人合作发表文章。此后他渐渐退出历史舞台。1980年退休之后,住在波士顿安度晚年。